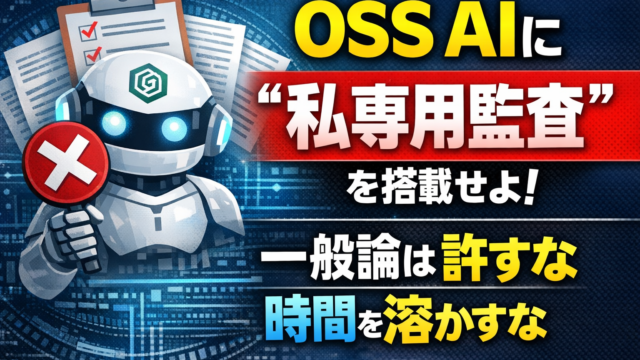

AI

AI OSS AIに“私専用監査”を搭載する方法:一般論を出させない設計

1|問題:一般論が出ると、時間が溶ける長文で壁打ちしていると、AIは高確率で「一般的に〜」へ逃げる。その瞬間、あなた側の作業はこうなる。 返答を読んで「違う」を説明 前提の再提示 方向修正 再生成ここに30分が消える。だから必要なのは、お願いや気合いではなく、出力前に“私向けか?”を自動検査する仕組み。2|目標:返信前に「私向け最適化か?」を常に検査させる欲しい挙動はこれ。 AIは返信を書き終えたら まず「これは一般論では?」を自己チェックし ダメなら書き直して 合格版だけを出すこれができれば、修正の往復が激減する。3|実装のコアは「二段構造」仕組みはシンプルに二段。A. 仮想モデル(あなたの前提)を固定で読み込むここで重要なのは「性格紹介」じゃない。判断ルールとして定義すること。例: 目的(何を最大化するか) 禁止(何を言われるとコストが爆増するか) 優先順位(何から提案すべきか) 運用制約(入力側に負担を増やす提案はNG、など)これを“モデルの人格”ではなく“採点基準”として置く。B. 出力前監査(採点→不合格なら書き直し)「気をつけて」ではなく、Yes/Noのチェックリストにする...